Dice no alle armi autonome e alla sorveglianza di massa, ma è utilizzata per il raid in Iran. Chi controlla davvero l’intelligenza artificiale? Il paradosso dell’etica nell’era degli algoritmi

La settimana scorsa, il 24 febbraio 2026, il Segretario alla Difesa USA Pete Hegseth aveva chiesto al CEO di Anthropic Dario Amodei di consegnare il suo modello IA senza alcuna restrizioni per un uso militare legittimo entro venerdì, invocando il Defense Production Act, risalente all’era della Guerra Fredda.

L’azienda ha rifiutato e giovedì scorso ha pubblicato sul suo sito le motivazioni, a 24 ore dall’ultimatum: “Credo profondamente nell’importanza esistenziale dell’uso dell’intelligenza artificiale per difendere gli Stati Uniti e le altre democrazie e per sconfiggere i nostri avversari autocratici”. Il discorso quindi iniziava proprio con l’ovvietà, ovvero che da sempre la startup avesse lavorato con questo fine, al fianco del Pentagono, avendo stipulato un accordo da 200 milioni di dollari siglato nel luglio 2025 per prototipare capacità IA di frontiera a supporto della sicurezza nazionale statunitense.

Nella nota di diniego Amodei spiega le sue ragioni: “In un ristretto numero di casi, riteniamo che l’IA possa minare, anziché difendere, i valori democratici. Alcuni utilizzi sono semplicemente al di fuori di ciò che la tecnologia odierna può fare in modo sicuro e affidabile. Due di questi casi d’uso non sono mai stati inclusi nei nostri contratti con il Dipartimento della Difesa e riteniamo che non dovrebbero esserlo ora”. I casi riguarderebbero la sorveglianza di massa interna e le armi completamente autonome.

Ora qui sta il punto. Il Dipartimento della Difesa americano aveva inviato un memorandum al Pentagono il 9 gennaio scorso dichiarando che avrebbe stipulato contratti solo con aziende di intelligenza artificiale che avrebbero acconsentito a “qualsiasi uso lecito”, rimuovendo le misure di sicurezza nei casi sopra menzionati. Ma il memorandum era stato pubblicato a inizio gennaio, e la nota di Anthropic è apparsa solo giovedì 26 febbraio, subito dopo che il Wall Street Journal, nella domenica precedente del 22 febbraio, aveva pubblicato l’articolo che svelava l’utilizzo di Anthropic nella missione in Venezuela per la cattura di Maduro e subito dopo che era avvenuto martedì 24 febbraio l’incontro tra Pete Hegseth e Amodei che invocava l’ultimatum.

La nota di giovedì scorso sottolinea allora proprio le minacce che sarebbero scaturite in quest’ultimo incontro: Hegseth avrebbe minacciato di rimuovere dai sistemi governativi l’IA di Anthropic qualora avessero continuato a mantenere quelle misure di sicurezza; non solo, ma con una seconda minaccia avrebbero designato l’IA di Anthropic come “rischio per la catena di approvvigionamento”. Queste ultime due minacce però appaiono intrinsecamente contraddittorie: una etichetta la sua IA, Claude, come un rischio per la sicurezza; l’altra etichetta Claude come essenziale per la sicurezza nazionale.

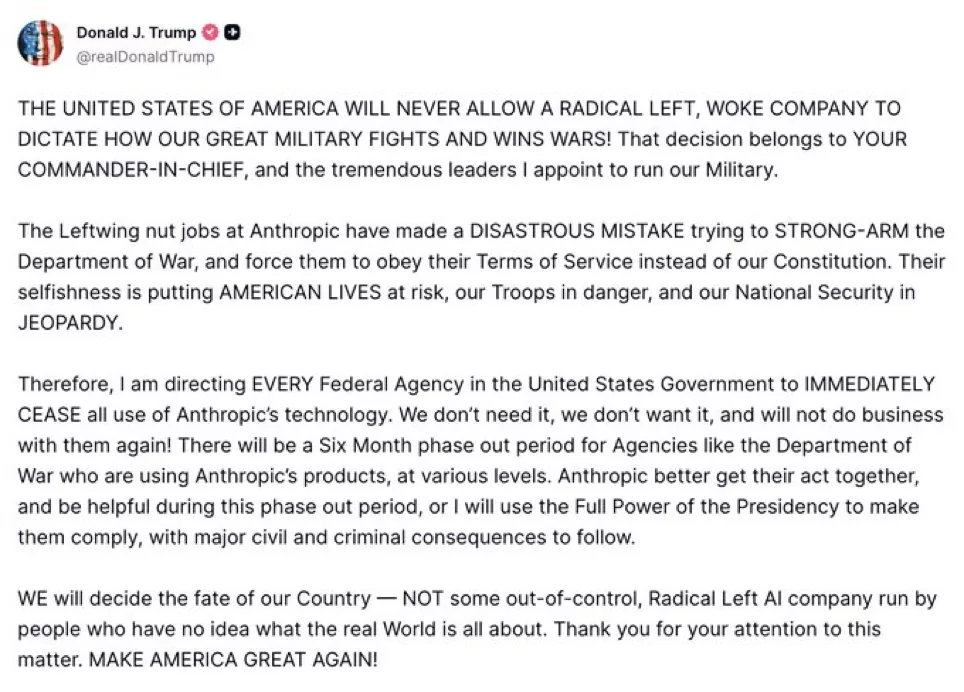

Venerdì scorso, il giorno dell’ultimatum, Amodei in una intervista rilasciata alla CBS News la poneva subito sul piano etico: “Si tratta del principio di difendere ciò che è giusto”. Così, con un post pubblicato su Truth Social, il presidente Donald Trump rispondeva ordinando alle agenzie federali di interrompere l’utilizzo dei prodotti dell’azienda, e concedendo un periodo di sei mesi per completare la transizione.

Tutto ciò ha aperto la strada all’invasione dei concorrenti, come OpenAI, che nella stessa giornata dichiarava di aver stipulato un accordo con il Pentagono per l’utilizzo della sua IA in contesti classificati, nel rispetto delle proprie esigenze di sicurezza. Open AI che ha da poco assunto Peter Steinberger, creatore di OpenClaw per la prossima generazione di agenti IA, riducendo il gap con Anthropic: ricordiamo che OpenClaw finora ha sempre usato i modelli Claude.

Ecco però arrivare sabato 28 febbraio 2026 l’attacco congiunto di USA e Israele in Iran, a quanto pare da tutti i Paesi inaspettato, provocando 201 morti e 747 feriti, danni a infrastrutture militari e nucleari, e la morte della Guida Suprema Ali Khamenei. Le stime però variano: il governo iraniano parla di oltre 3.000 morti, mentre fonti USA e HRANA indicano cifre più alte, fino a 7.000 o 32.000. L’Iran ha poi risposto con missili e droni, causando un morto, 22 feriti a Tel Aviv, distruggendo basi USA, con droni su Oman e altri, per poi “chiudere” lo Stretto di Hormuz, con inevitabili impatti economici per i trasporti petroliferi e assicurazioni marine.

Eppure, sempre secondo il Wall Street Journal, anche per l’attacco in Iran il governo americano, nonostante il diniego di Anthropic, avrebbe usato la sua IA per analisi di intelligence e simulazioni operative di guerra.

Negli ultimi giorni però, il chatbot Claude di Anthropic ha raggiunto il primo posto nei download sull’App Store di Apple, superando per la prima volta ChatGPT di OpenAI. Lunedì, alcune delle app di intelligenza artificiale dell’azienda hanno subito un breve crash a causa di quella che l’azienda ha definito “una domanda senza precedenti”. I fan stanno letteralmente scendendo in piazza per esprimere il loro apprezzamento.

Tanti sono gli spunti di riflessione dietro tutta questa faccenda. Ma uno è particolarmente rilevante: quando ci si fa scudo dietro principi etici, è difficile discernere e mantenere saldi tali principi nel lungo periodo. Certo, Amodei lasciò OpenAI con la sorella Daniela (entrambi nella foto tratta dal media kit disponibile sul sito di Anthropic) per divergenze etiche sulla sicurezza IA e la corsa commerciale, fondando Anthropic come alternativa “responsabile” a OpenAI stessa. Certo, ora Anthropic può anche aver perso come cliente l’intero governo degli Stati Uniti, definendo un nuovo capitolo nel rapporto tra Washington e la Silicon Valley. Ma la sua intelligenza artificiale, il suo prodotto, è stato comunque utilizzato dal governo nonostante il dissenso del CEO. Questo sottolinea quanto ogni singola scelta ha un peso, una ricaduta, e anche un’idea, seppur legittima, perché etica, politica o economica, ogni singolo dollaro la può, alla fine dei conti, barattare.

© RIPRODUZIONE RISERVATA