Indice degli argomenti

La physical AI rappresenta l’evoluzione più significativa dell’intelligenza artificiale contemporanea, trasformando i sistemi da meri analizzatori di dati a agenti capaci di percepire, ragionare e agire nel mondo fisico. A differenza dell’automazione tradizionale, rigida, pre-programmata e isolata, la physical AI integra percezione sensoriale avanzata, modelli di ragionamento autonomo e controllo in tempo reale per creare sistemi adattivi, intelligenti e collaborativi.

Nel contesto manifatturiero, questa transizione rappresenta un’opportunità straordinaria per le aziende europee e italiane: non solo per automatizzare operazioni ripetitive, ma anche per abilitare forme di collaborazione uomo-macchina inedite, ridurre significativamente i tempi di riconfigurazione produttiva, e affrontare le sfide di flessibilità che la produzione ‘high-mix, medium-volume’ pone da decenni.

Secondo il World Economic Forum, i sistemi AI-powered raggiungono fino al 40% di efficienza operativa in più rispetto all’automazione tradizionale[1]. Il mercato globale della robotica industriale è destinato a contare 609mila nuove installazioni nel 2026[2], con la robotica collaborativa che rappresenta la quota più veloce in crescita. L’impatto estende oltre la produttività: dalla sicurezza dei lavoratori alla riduzione delle emissioni di carbonio, dalla qualità del prodotto al throughput operativo.

Questo approfondimento analizza l’architettura tecnica della physical AI, le differenze fondamentali con l’IA puramente digitale, i componenti abilitanti, dalla meccatronica al controllo edge, e i casi d’uso industriali emergenti che ridefiniscono competitività, safety e sostenibilità nel manufacturing.

Cos’è la physical AI

Definizione

La physical AI è un sistema di intelligenza artificiale che percepisce, ragiona, pianifica e agisce direttamente nel mondo fisico, tramite sensori, elaborazione distribuita in tempo reale e attuatori intelligenti. A differenza dei modelli di AI tradizionali, che operano esclusivamente su dati e algoritmi in ambienti digitali, la physical AI è incarnata (embodied): la sua intelligenza risiede in un corpo fisico – robot, macchina, veicolo, infrastruttura – che interagisce continuamente con l’ambiente circostante [3].

Jensen Huang, CEO di NVIDIA, ha sintetizzato l’evoluzione dell’IA in quattro tappe durante il CES 2025[4]:

- perception AI: riconosce immagini, voci, pattern in dati statici;

- generative AI: crea testi, immagini, codice a partire da prompt;

- agentic AI: ragiona, pianifica e agisce autonomamente in ambienti digitali;

- physical AI: percepisce, ragiona, pianifica e agisce nel mondo fisico.

Concretamente, un sistema di physical AI è composto da tre strati architetturali integrati[4]:

| Strato | Funzione | Tecnologie |

| Percezione | Interpretare l’ambiente tramite sensori e data fusion | Computer vision, LIDAR, sensori tattili, audio |

| Ragionamento | Pianificare l’azione ottimale in tempo reale usando modelli AI | Neural networks, foundation models, reinforcement learning |

| Azione | Eseguire tramite attuatori e sistemi di locomozione | Motori, bracci robotici, sistemi di posizionamento, AMR (Autonomous Mobile Robots) |

Cosa non è physical AI

È cruciale distinguere la physical AI da fenomeni correlati ma concettualmente diversi:

Non è automazione tradizionale. I sistemi di automazione industriale convenzionali operano secondo logiche rigide e preprogrammate: un robot 6-assi esegue un percorso fisso per uno specifico task. Se il task cambia, l’intero sistema deve essere riprogrammato, con costi di downtime significativi. La physical AI, al contrario, si adatta, impara e reagisce a contesti imprevedibili senza necessità di riprogrammazione manuale[5].

Non è semplice robotica. Una robotica tradizionale è ‘cieca’ ai cambiamenti ambientali. La physical AI integra percezione avanzata, ragionamento autonomo e controllo adattivo in time-real, trasformando il robot da macchina isolata a agente intelligente capace di collaborazione con umani e altri sistemi[3].

Non è solo IA nel cloud. Mentre la generative AI si basa su modelli addestrati in datacenter e interrogati via API, la physical AI richiede inferenza locale, a bassissima latenza, direttamente sul dispositivo edge. Una decisione di sicurezza critica (frenata di emergenza, regolazione di forza) non può tollerare latenze di rete o dipendenze dal cloud [6].

Differenze fondamentali tra IA digitale e IA embodied

L’IA digitale vive in cloud e datacenter, elabora dati strutturati, immagini statiche o testo e produce output informativi, con latenze di secondi generalmente accettabili. L’IA embodied porta l’intelligenza su robot e dispositivi edge, percepisce l’ambiente tramite sensori in tempo reale e agisce direttamente nel mondo fisico con latenze nell’ordine dei millisecondi, critiche per la safety. È progettata per adattarsi online durante l’operazione, ma introduce rischi fisici (collisioni, forze, movimenti) che richiedono monitoraggio e controllo real-time. Architetture, scalabilità e dipendenza dalla rete cambiano a seconda del tipo di applicazione e use case.

Implicazioni architetturali

La physical AI richiede un’architettura distribuita a più livelli, non centrata solo sul cloud:

- livello di calcolo ad alte prestazioni: infrastrutture GPU o server specializzati addestrano foundation models e world simulators per robotica e controllo industriale;

- livello di simulazione: ambienti digital twin e simulazioni physics‑accurate permettono ai sistemi di eseguire milioni di iterazioni in tempo accelerato, sviluppando competenze trasferibili al mondo reale;

- livello edge: dispositivi locali su macchine e robot eseguono modelli in inference con latenze dell’ordine delle decine di millisecondi, abilitando decisioni real‑time.

A differenza dell’IAdigitale, che spesso elabora batch di dati storici, la physical AI deve fondere in tempo reale stream multimodali (vision, LIDAR, sensori tattili e di forza) entro finestre temporali inferiori a 100 ms, con algoritmi ottimizzati per l’esecuzione al bordo.

Componenti Tecnici Abilitanti

I componenti tecnici abilitanti della Physical AI sono:

- sensori multimodali (telecamere, LiDAR – light detection and ranging, radar, tattili, inerziali) per percezione real-time dell’ambiente;

- edge AI e computing distribuito (es. NVIDIA Jetson/Orin) per elaborazione locale a bassa latenza (<50ms); meccatronica integrata con attuatori, motori e bracci robotici per esecuzione fisica;

- modelli agentici per ragionamento, pianificazione e apprendimento continuo;

- digital twin e simulazioni physics-accurate (es. Omniverse) per training sicuro e scalabile.

Questa stack trasforma macchine passive in sistemi autonomi adattivi che migliorano l’interazione uomo-macchina.

Le applicazioni industriali della physical AI stanno rivoluzionando la manifattura, con enfasi su automazione adattiva e resilienza operativa.

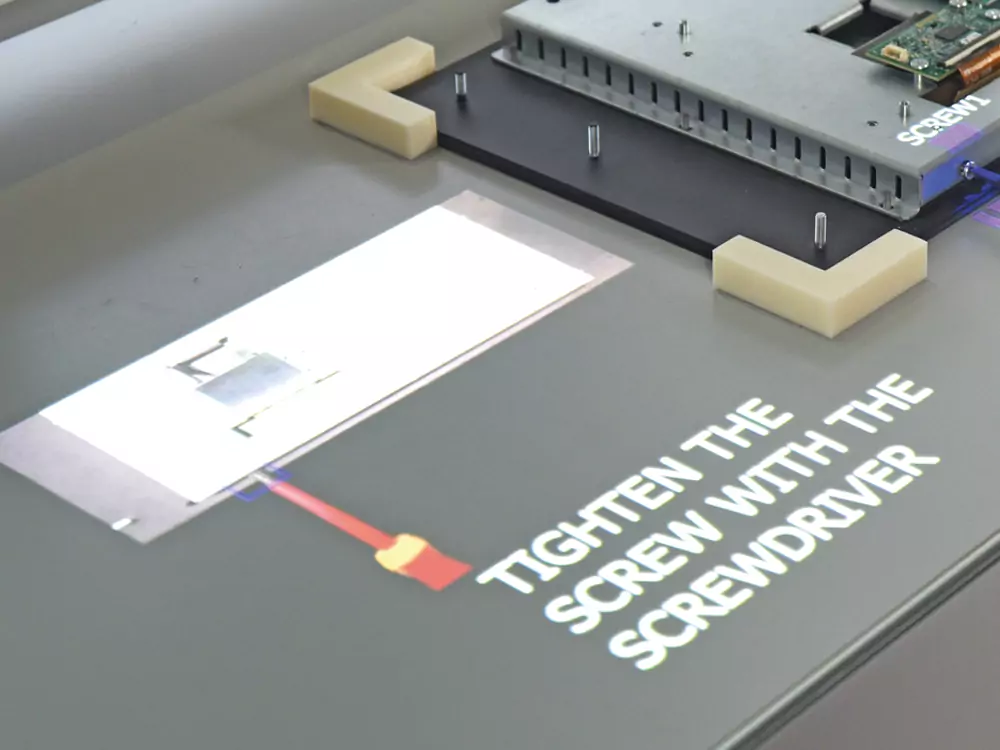

Assemblaggio e manifattura flessibile

- Robot collaborativi (cobots) e umanoidi per assemblaggio high-mix/low-volume senza riprogrammazione: avviti, inserimento cavi, manipolazione componenti variabili. Foxconn ha ridotto tempi ciclo del 20-30%, errori 25% e OPEX 15%.

- Ispezione qualità AI-driven con computer vision: rilevamento difetti in tempo reale, yield +40% vs automazione tradizionale.

Logistica e Material Handling

- AMR e AGV adattivi per palletizing dinamico, path planning anti-collisione: efficienza viaggio +10% (Amazon).

- Gestione flotta autonoma in magazzini: throughput +25%, downtime ridotto.

Manutenzione Predittiva e Monitoraggio

- Digital twin + sensori per manutenzione proattiva su macchine e linee: PepsiCo identifica 90% anomalie pre-fail.

- Controllo processi con AI physics: ottimizzazione real-time in fabbriche Siemens (pilota Erlangen 2026).

Robotica Collaborativa e Sicurezza

- Cobots force-sensitive per finitura, polishing, task umani: integrazione uomo-macchina, sicurezza +30%.

- Fabbriche AI-driven: Siemens, Foxconn, HD Hyundai, KION, PepsiCo testano linee autonome.

Nota: l’autore è CTO di e-Novia

References

[1] World Economic Forum. (2025). Physical AI: Powering the New Age of Industrial Operations. https://reports.weforum.org/docs/WEF_Physical_AI_Powering_the_New_Age_of_Industrial_Operations_2025.pdf

[2] International Federation of Robotics (2025). Global Robotics Survey. Stima di 609.000 installazioni robotiche previste nel 2026.

[3] Fujitsu Research Institute. (2026, January 16). The Rise of Physical AI: From Humanoid Robotics to Industrial Reality. https://global.fujitsu/-/media/Project/Fujitsu/Fujitsu-HQ/insight/tl-rise_of_physical_ai-20260116/The-Rise-of-Physical-AI—From-Humanoid-Robotics-to-Industrial-Reality-en.pdf

[4] NVIDIA. (2025, January). CES 2025 Keynote: The Next Wave of AI. Discorso di Jensen Huang, CEO NVIDIA, presentante l’evoluzione da Perception AI → Generative AI → Agentic AI → Physical AI.

[5] e-Novia. (2025). Physical AI: Perché l’Italia Può Diventare Leader Mondiale nell’Intelligenza Artificiale Fisica https://e-novia.it/news/italia-leader-mondiale-physical-ai

[6] Deloitte. (2025, December). Humanoid Robots and Beyond: Physical AI in Enterprise. https://www.deloitte.com/us/en/insights/topics/technology-management/tech-trends/2026/physical-ai-humanoid-robots.html

[7] Meta Intelligence. (2025, November 28). Tesla Optimus, Figure 02 & NVIDIA Isaac Status. Analisi dei robot humanoid in deployment commerciale. https://www.meta-intelligence.tech/en/insight-physical-ai

[8] Wevolver. (2026, March 9). The 2026 Edge AI Technology Report—Chapter 5: Physical AI & Embodied AI. https://www.wevolver.com/article/the-2026-edge-ai-technology-report/physical-ai-embodied-ai

[9] LinkedIn. (2026, January 15). Embodied AI & Robotics in 2026: Where Intelligence Meets Action. https://www.linkedin.com/pulse/embodied-ai-robotics-2026-where-intelligence-meets-action-te1kc

[20] DT Engineering. (2026, March 2). Collaborative Robots (Cobots) in Manufacturing: Safety & Efficiency. https://www.dtengineering.com/articles/collaborative-robots-cobots-transforming-manufacturing-safety-and-efficiency

[21] Deloitte. (2025, December 9). Onboard computing and processing: Neural Processing Units for edge AI. Discussione della capacità di NPU per low-latency inference. https://www.deloitte.com/us/en/insights/topics/technology-management/tech-trends/2026/physical-ai-humanoid-robots.html

[22] International Federation of Robotics / DT Engineering. (2026). Definizione e caratteristiche di robot collaborativi secondo IFR standard. https://www.dtengineering.com/articles/collaborative-robots-cobots-transforming-manufacturing-safety-and-efficiency

[23] ForECR. (2026, February 16). Edge AI in Industrial Automation: Real-Time Control and Predictive Analytics. https://www.forecr.io/blogs/embedded-systems/edge-ai-in-industrial-automation-real-time-control-and-predictive-analytics

[24] Meta Intelligence. (2025, November 28). BMW case study con Figure 02, ITRI pilot scenarios. https://www.meta-intelligence.tech/en/insight-physical-ai

[25] DOBOT. (2025, December 18). Collaborative Robots (Cobots) in Manufacturing: The Future. CR5S con 3D vision per quality inspection e sorting. https://www.dobot-robots.com/insights/news/collaborative-robots-in-manufacturing.html

[26] ARM. (2025, September 22). Seven Edge AI Use Cases Powering Real Life—Smart Manufacturing section. https://newsroom.arm.com/blog/seven-edge-ai-use-cases-powering-real-life

[27] AuroNIQ Robotics. (2026, February 6). WEF-Davos 2026: Physical AI and Robotics as Central Future Trend. https://auroniq-robotics.com/en/wef-davos-2026-physical-ai-und-robotics-als-zentraler-zukunftstrend/

[28] NCBI / PMC. (2024, December 1). Integrating collaborative robots in manufacturing, logistics, and… Survey di implementazione cobot in tre settori. https://pmc.ncbi.nlm.nih.gov/articles/PMC11646840/

[29] Automate.org. (2026, March 8). AI at the Edge: From Vision to Action. Industrial AI at the edge per machine vision, robotics control, AMR navigation. https://www.automate.org/videos/ai-at-the-edge-from-vision-to-action

[30] YouTube. (2025, December 31). These New AI Robots Are About to Become Real in 2026. https://www.youtube.com/watch?v=t-GeDuS3qWw

[31] ScienceDirect. (2020). Safety assurance mechanisms of collaborative robotic systems in manufacturing. https://www.sciencedirect.com/science/article/abs/pii/S0736584520302337

[32] ÈconomyMagazine. (2026, March 6). Robot e IA la risposta alla fuga dei giovani dalla manifattura. https://www.economymagazine.it/robot-e-intelligenza-artificiale-nelle-fabbriche-italiane-la-risposta-alla-fuga-dei-giovani-dalla-manifattura

[33] ALAScom. (2025, December 3). Robotica nel 2026: le 5 tendenze che cambieranno il modo di produrre. https://www.alascom.it/ultime-notizie/robotica-nel-2026-le-5-tendenze-che-cambieranno-il-modo-di-produrre-e-lavorare

[34] AzzurroDigitale. (2025, April 2). Gli AI Agents e il futuro della manifattura—Verso fabbriche intelligenti e sostenibili. Industrial Copilot di Siemens case study, impatto di AI agents su produttività. https://www.azzurrodigitale.com/gli-ai-agents-e-il-futuro-della-manifattura-verso-fabbriche-intelligenti-e-sostenibili/

[35] TiNovaMag. (2025, October 21). Meccatronica: Le 6 tecnologie per la fabbrica del futuro. https://tinnovamag.com/meccatronica-le-6-tecnologie-per-la-fabbrica-del-futuro/

[36] GlobalInsightServices. (2025, September 30). LIDAR in Industrial Automation Market Analysis and Forecast to 2034. Market size e trend per LIDAR technology. https://www.globalinsightservices.com/reports/lidar-in-industrial-automation-market/

[37] Scopieno. (2024). LIDAR and AI Based Surveillance of Industrial Processes. https://sciendo.com/2/v2/download/article/10.2478/ttj-2023-0002.pdf

[38] TIM Enterprise. (2025, March 24). Con il 5G cresce la produttività dell’industria manifatturiera. Impatto di 5G + AI sulla productivity e sustainability. https://www.gruppotim.it/it/archivio-stampa/mercato/2025/CS-TIM-Enterprise-BIREX-25-03-25.html

[39] PoliMi / Rocco. (Accesso libero). Controlli automatici per la meccatronica. https://rocco.faculty.polimi.it/cam/informatica_controllo.pdf

[40] Allerin. (2023, June 26). Computer Vision for Industrial Automation: Applications and Benefits. https://www.allerin.com/blog/computer-vision-for-industrial-automation-applications-and-benefits/

[41] Altair Engineering. (1999-ongoing). Soluzioni per Sistemi Meccatronici. https://altairengineering.it/mechatronics

[42] LinkedIn. (2025, July 27). Industrial Vision Sensors Market Metrics | Analysis by Type. https://www.linkedin.com/pulse/industrial-vision-sensors-market-metrics-analysis-dq1ce

[43] TecnoForIndustry. (2022, December 6). Meccatronica: Cos’è, a cosa serve e gli ambiti applicativi. https://tecno4industry.it/meccatronica/

[44] Raise Summit. (2026, March 12). 20 Physical AI Companies to Watch in 2026. https://www.raisesummit.com/de/post/20-physical-ai-companies-to-watch-in-2026

[45] Scalvini, L., Adrodegari, F., & Saccani, N. (2026, February). Everything-as-a-Service nel manifatturiero: Framework per adozione XaaS. Articolo pubblicato su Production & Manufacturing Research, Università di Brescia (ASAP Center), finanziato da MICS/PNRR/NextGenerationEU. https://www.innovationpost.it/modelli-business/everything-as-a-service-xaas-nel-manifatturiero-come-trasformare-la-vendita-di-prodotti-in-servizi/

© RIPRODUZIONE RISERVATA